Wordt het geen tijd voor een AI-grondwet?

In mijn werk bij PubliContact help ik overheden om hun dienstverlening te verbeteren. En steeds vaker speelt AI daarin een rol. Bijvoorbeeld bij het schrijven van adviezen, het structureren van plannen of het aanscherpen van ideeën. Soms voelt het alsof ik een persoonlijke sparringpartner in mijn laptop heb. En toch word ik nog regelmatig verrast door hoe goed het werkt. De snelheid waarmee AI zich ontwikkelt is net zo verbazingwekkend.

Door: Niels Venniker – Senior Adviseur Overheidsdienstverlening bij PubliContact

AI die zichzelf opvoedt, mooi…maar wie controleert dat?

Vorige maand las ik in NRC: “AI ontwerpt zichzelf – en wordt slimmer dan wij kunnen volgen.” Dat zette me aan het denken. Stel je voor: het is 2032. Een algoritme beslist over je hypotheekaanvraag, bepaalt de route van ambulances en stemt misschien zelfs mee in de gemeenteraad. Niemand weet precies hoe het algoritme werkt. Klinkt als sciencefiction? Misschien, maar ik merk dagelijks dat we dichterbij komen dan we denken.

Steeds vaker kom ik termen als AGI – Artificial General Intelligence – tegen. Een term die bijna magisch klinkt: AI die niet alleen taken uitvoert, maar denkt, leert en zich aanpast zoals een mens. Volgens experts als Sam Altman (OpenAI) en Demis Hassabis (DeepMind) is dat geen sciencefiction meer: het zou binnen vijf tot tien jaar werkelijkheid kunnen worden. Andere experts vinden dat weer overdreven, maar het feit dat deze voorspelling serieus wordt besproken, maakt dat ik er toch over nadenk.

Niet omdat ik bang ben voor “de robot die ons overneemt”. Maar als AI straks niet meer alleen uitvoert, maar zelf denkt, wie bepaalt dan wat het wel en niet mag doen? Wanneer zijn wij nog in control? Ik denk dan vaak terug aan de sciencefictionboeken van Isaac Asimov, waarin alle robots waren geprogrammeerd met drie wetten. Die wetten waren eenvoudig, maar krachtig – en bepaalden hoe robots zich moesten gedragen ten opzichte van mensen. Ze gaven houvast.

Hier mijn voorstel, geïnspireerd op Asimov – maar geschreven voor 2025 en toegespitst op de praktijk van publieke dienstverlening:

Kan Asimov iets voor ons betekenen?

Misschien is het tijd voor een eigentijdse versie. Geen sciencefictionwetten, maar een gedeelde basis, een compacte leidraad die we samen ontwikkelen. Een soort AI-grondwet, die ons herinnert aan waar het om draait: AI inzetten om mens en maatschappij op een duurzame manier verder te helpen ontwikkelen.

Natuurlijk: elk AI-systeem bevat al regels. Vangrails, parameters. Alleen: die zijn meestal technisch, ondoorzichtig en per organisatie verschillend. We weten vaak niet welke keuzes al in zo’n systeem zijn ingebakken – en we hebben geen gedeeld kader waar die keuzes aan getoetst worden. Iedereen bedenkt het nu zelf. Misschien is het tijd om daar iets collectiefs tegenover te zetten.

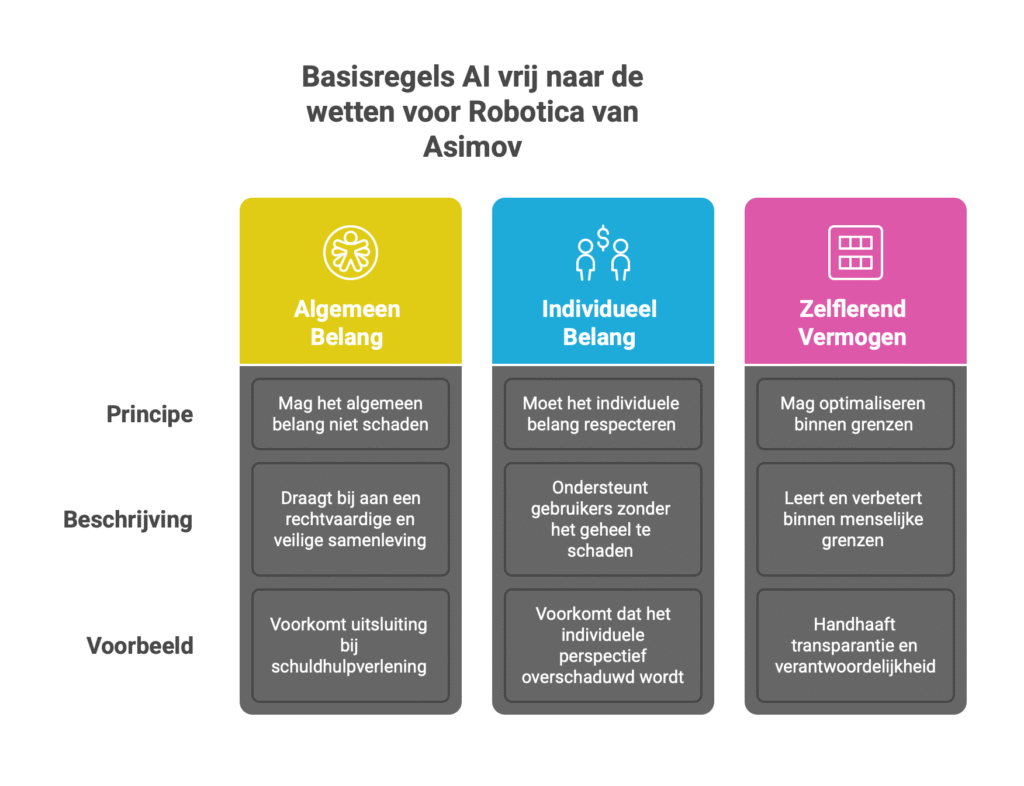

Wet 1 – Algemeen belang

AI mag het algemeen belang niet schaden – niet door te handelen, en niet door nalatigheid.

AI moet bijdragen aan een rechtvaardige, veilige en menswaardige samenleving. Dit is de hoogste wet.

Denk aan een AI-systeem dat aanvragen voor schuldhulpverlening automatisch filtert. Als dat systeem – bewust of onbewust – bepaalde bevolkingsgroepen uitsluit op basis van profieldata, raakt dat het algemeen belang direct. Zonder zo’n wet kan de menselijke maat verdwijnen achter een ‘objectief’ algoritme.

Wet 2 – Individueel belang

AI moet de belangen en het perspectief van de mensen respecteren, tenzij dit in strijd is met de Eerste Wet.

AI ondersteunt individuele gebruikers – maar nooit ten koste van het grotere geheel.

Een werkzoekende gebruikt een AI-tool van het UWV die sollicitatieadviezen geeft. De AI baseert zich op eerdere zoekgeschiedenis en zegt: “U heeft een lage kans op succes in deze sector, probeer iets anders.” Maar de gebruiker gelooft er juist in. Zonder deze tweede wet zou AI het individuele perspectief ondersneeuwen onder historische data.

Wet 3 – Zelflerend vermogen met grenzen

AI mag zichzelf optimaliseren of beschermen, zolang dit de Eerste en Tweede Wet niet schaadt.

AI mag leren, verbeteren en functioneren – maar altijd binnen menselijke grenzen.Een zelflerend AI-systeem verbetert zich op basis van gebruikersdata. Handig, totdat het keuzes maakt die niemand meer begrijpt – inclusief de makers. Als AI zichzelf mag optimaliseren zonder grenzen, ondermijnt dat transparantie én verantwoordelijkheid.

Of dit de basis voor een grondwet voor AI is? Ik weet het niet. Maar ze geven wel richting en houvast. Ze helpen mij – en hopelijk ook anderen – om AI niet alleen als tool te zien, maar als iets waarvoor wij als mensen verantwoordelijkheid moeten nemen – op tijd, doordacht en met oog voor de wereld waarin we leven. En eerlijk gezegd: ik weet niet altijd of ik daar zelf klaar voor ben. Ik ben enthousiast, ja, en ik geloof in de kansen. Tegelijkertijd voel ik ook hoe makkelijk het is om gewoon door te gaan zonder stil te staan bij wat we eigenlijk aan het bouwen zijn. En laten we eerlijk zijn: in de praktijk gaan de wetten wringen. Wat als snelheid en efficiëntie botsen met inclusie en uitleg? Wat als AI ‘gelijk’ heeft, maar de mens zich niet gehoord voelt? Richting geven is belangrijk – maar dat betekent ook: moeilijke keuzes maken.

Met alleen wetten zijn we er nog niet volgens mij…

En dan is er nog iets: wetten opstellen is één ding, maar ze moeten ook vertaald worden naar de praktijk. Want wie bepaalt wat het algemeen belang is? Een publieke toetsingscommissie of democratisch vastgestelde kaders? En hoe toets je of een AI zich aan zo’n wet houdt – of dat het systeem daar stilletjes van afwijkt? Misschien hebben we straks niet alleen AI-wetten nodig, maar ook AI-toezichthouders, toetsingskaders, en een voortdurend lerend ethisch kompas.

Samen met mijn collega’s bij PubliContact geloof ik in samen leren en verbeteren. Want technologie verandert snel, en de behoeften van burgers en bedrijven ook. Door samen te onderzoeken, adviseren en begeleiden werken we aan een toekomstbestendige, mensgerichte en verantwoorde publieke dienstverlening. Met AI als krachtig hulpmiddel, maar altijd met de menselijke maat als kompas.

Zo’n AI-grondwet is geen eenmalige exercitie, maar een doorlopend gesprek. En ik hoop dat we samen bouwen aan een overheid waar burgers en bedrijven trots op kunnen zijn. Hoe kijk jij daar tegenaan? En is dit dan die gemeenschappelijke basis?

Praat erover met Niels Venniker. Je kunt hem bereiken op n.venniker@publicontact.nl